Ji, Xingwu, Peilin Liu, Haochen Niu, Xiang Chen, Rendong Ying, and Fei Wen. “Loop Closure Detection Based on Object-Level Spatial Layout and Semantic Consistency.” arXiv, April 14, 2023. http://arxiv.org/abs/2304.05146.

1 Introduction

本文做出的贡献:

- 在3D 场景图中基于拓扑结构与几何匹配的回环检测方法,利用物体的信息和它们的邻域来建立3D 拓扑结构,保证几何布局以及语义属性的一致;

- 包含语义标签、bounding box IoU、物体颜色编码、物体级embedding 信息的物体级数据关联方法,基于该方法构建了3D 语义地图;

- 一个完整的视觉SLAM 系统,实验结果表证明了本算法的优越性。

3 Object-Level Semantic Mapping

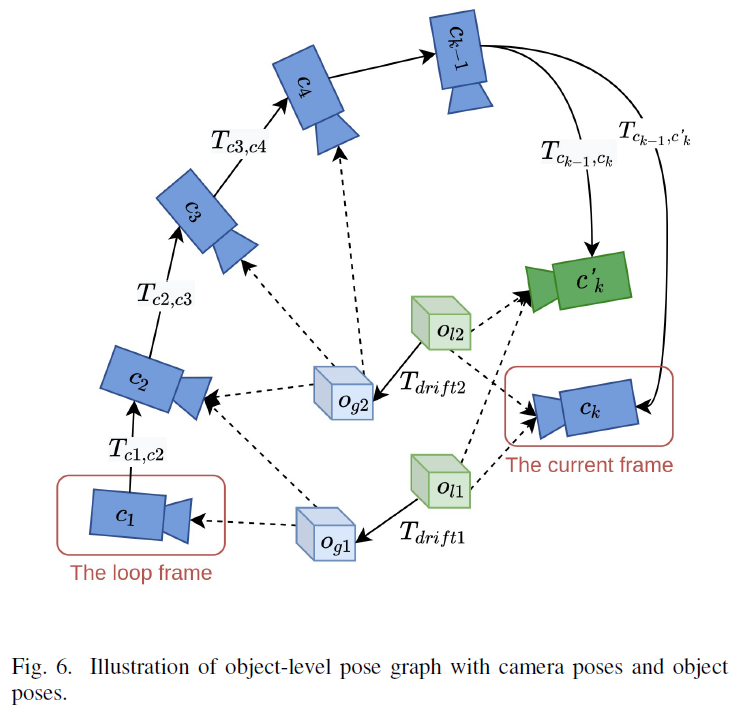

本系统的架构如Fig. 2所示:

- 基于双目里程计利用双目RGB 图片流获取初步的相对位姿;

- 利用一个物体提取网络来进行语义标记,并生成2D bounding boxes 和3D 立方体proposals;

- 将bounding boxes 输入instance-feature 学习网络来提取物体级的embeddings;

- 利用物体的语义等信息实现局部地图中的物体和全局地图中物体的数据关联,若全局地图中没有物体与检测到的物体实现匹配,则在全局地图中添加一个cuboid;

- 基于数据关联,利用物体位姿求解算法来将新检测到的物体放入全局地图的cuboid中,利用BA 同时优化物体与相机的位姿。

3.1 Object Semantic Information Extraction

3.1.1 Geometry information

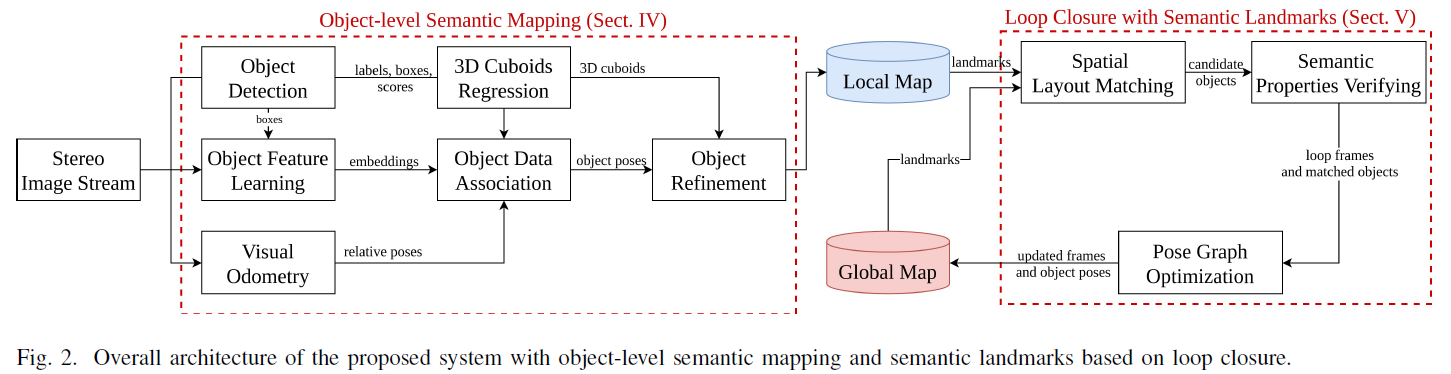

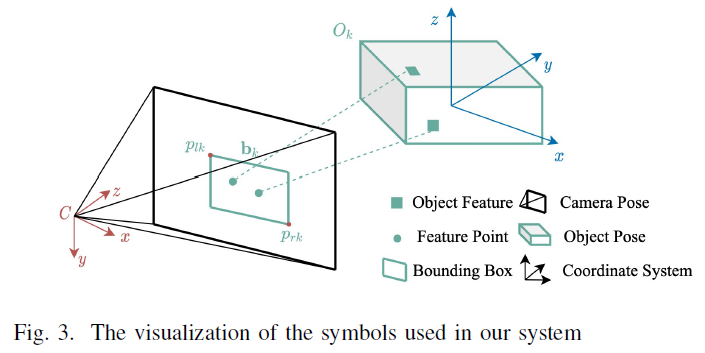

几何信息包含:语义标签、物体尺寸、2D bounding boxes 以及 3D 立方体proposals。作者使用VisualDet3D 来提取2D bounding boxes 以及 3D 立方体,在所有物体均位于统一平面上的假设下,一个物体的3D cuboid 包含7自由度:3位置、3尺寸、yaw角,获取过程如Fig. 3所示。值得注意的是,作者在数据关联过程中忽略了那些体积过大或者距离相机过远的物体,以方便后续的3D 环境重建和回环检测。

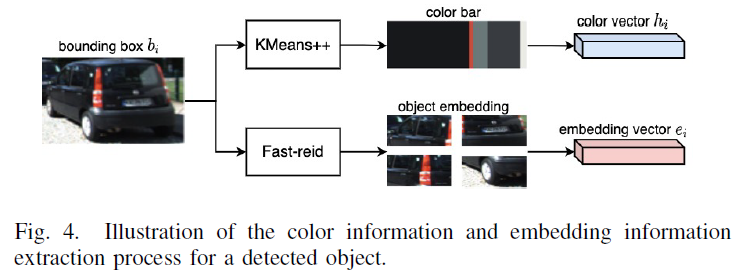

3.1.2 Color information

为获取图片的颜色信息,作者将RGB 格式的图片转换为HSV (hue, saturation and value)格式,bounding box内的区域作为物体在图片中的区域,作者使用K-means++ 算法将物体的HSV 数值进行聚类,并分为K 个集群,对于每个集群选取其中心作为该集群的基本色彩,然后使用 K维的特征向量来表示集群色彩直方图的分布,以该向量作为物体的色彩信息。

3.1.3 Embedding information

相似地,作者使用bounding boxes区域作为物体的图像块image patches,利用fast-reid 算法将patches 编码为向量表示。注:fast-reid 算法经VERI-Wild 数据集进行预训练。

3.2 Object Data Association

假设在第 $c_i$ 帧照片上检测到N 个物体,则表示为 $D = \{d_i\}_N$ , $d_i = \{l_i, b_i, h_i, e_i, T_{co}\}$ ,其中,$l_i$ 表示语义标签,$b_i$ 表示bounding box,$h_i$ 表示归一化的颜色直方图,$e_i$ 表示物体embedding,$T_{co}$ 表示物体在相机坐标系中的位姿。

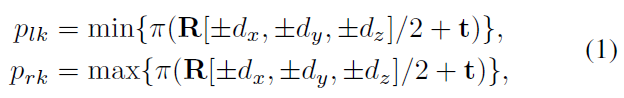

相应地,全局地图中存在M 个物体地标 $O = \{o_k\}_{k=1}^M$ ,每一个地标可表示为 $ o_k = \{\tilde{l}_k, \tilde{u}_k, \tilde{b}_k, H_k, E_k, T_{wo_k}\}$ ,其中,$\tilde{l}_k$ 表示语义标签,$H_k = \{\tilde{h}_j\}_{j=1}^n,E_k= \{\tilde{e}_j\}_{j=1}^n$ 分别是过去n 个匹配的颜色直方图和物体embedding 向量组,$T_{wo_k}$ 是物体在世界坐标系中的坐标,$\tilde{u}_k,\tilde{b}_k$ 分别是cuboid 和 bounding box。bounding box 是由 cuboid 处理得到的:将cuboid 的8个顶点映射到图片中,获取x-y 坐标的最小值与最大值来形成一个矩形:

其中,$\pi(.)$ 表示相机映射方程, R,t表示旋转与平移矩阵。

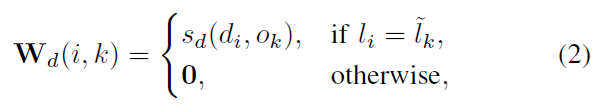

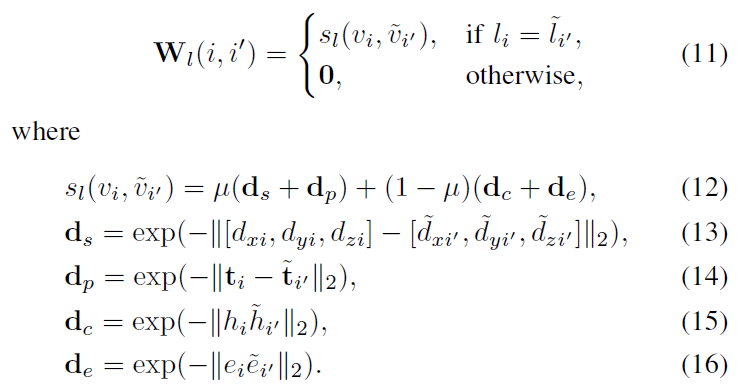

物体相似度计算如下所示:

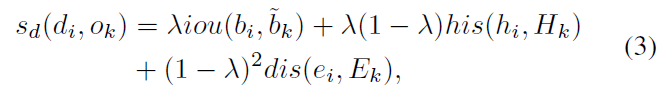

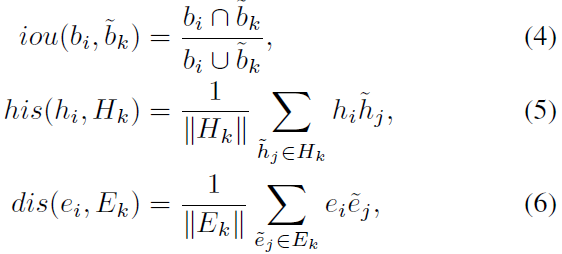

相似度计算涉及到物体的bounding boxes,颜色直方图以及物体embedding:

其中,

3.3 Object Pose Refinement

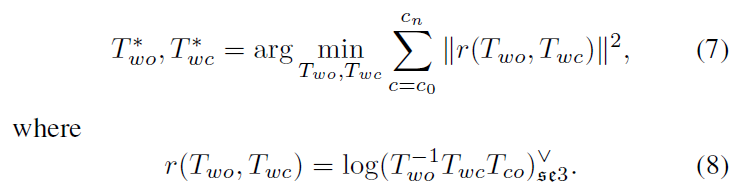

实现数据关联之后,使用相机运动模型和物体空间定位来优化位姿。使用BA 联合优化物体与相机的位姿,形成一个非线性最小二乘优化问题:

其中,$c_0, c_n$ 表示跟踪的图片帧数范围。作者采用VINS-Fusion 的滑动窗口优化机制。由此构建一个有着精确物体位姿的物体级语义地图。

4 Loop Closure With Semantic Landmarks

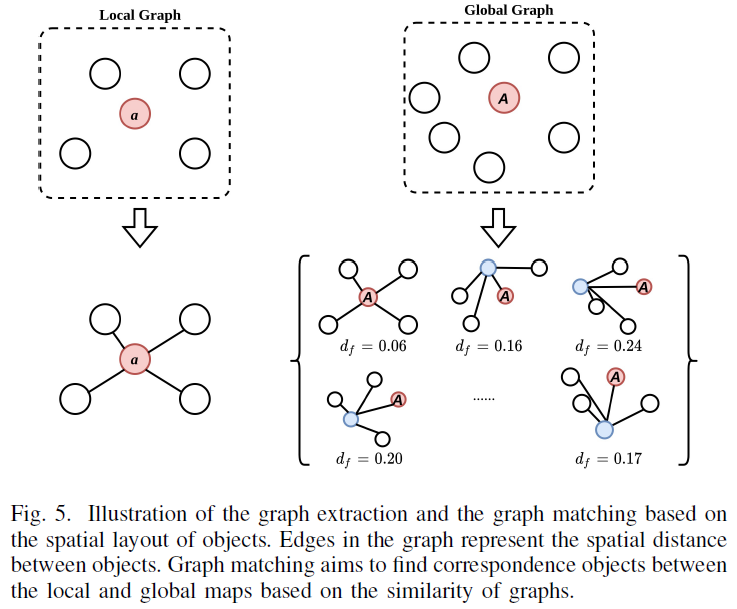

基于空间拓扑以及顶点属性,作者采用两步拓扑图匹配来确认局部图与全局图之间的联系:

- 首先构建邻域拓扑结构,并基于空间布局一致性选取局部地图与全局地图的候选匹配;

- 计算语义相似度,选取相似度最高的匹配组。

4.1 Graph Generation

顶点包含语义标签,颜色直方图向量,以及物体embedding 信息;顶点之间的边是由物体之间的空间距离决定的,作者选取K 个最近的邻接顶点进行连接。基于此,可分别根据局部地图与全局地图获取相应的图 $G_l, G_g$ 。

4.2 Spatial Layout Matching

4.3 Semantic Properties Verifying

经过空间布局匹配之后得到的候选匹配点需进一步计算语义属性的一致性:

其中,$[d_x, d_y, d_z],t$ 表示顶点的尺寸和位置信息,$h, e$ 分别表示顶点的颜色和embedding 信息。最终,匹配点对的相似度需要大于一个阈值才可判定为匹配对。

4.4 Pose Graph Optimization

在回环检测中,当前帧的物体可能与之前多个帧中的物体匹配上了,此时选择第一个匹配帧作为回环检测对象,如Fig. 6所示。