Zhang, Zhihuang, Meng Xu, Wenqiang Zhou, Tao Peng, Liang Li, and Stefan Poslad. “BEV-Locator: An End-to-End Visual Semantic Localization Network Using Multi-View Images.” arXiv, November 27, 2022. http://arxiv.org/abs/2211.14927.

1 Introduction

作者认为,本文提出的BEV-Locator 是第一个利用端到端学习框架解决视觉语义定位问题的工作,主要贡献如下:

- 提出一个新颖的端到端视觉语义定位架构,利用多视角图片和语义环境实现自身位姿的精确估计,数据驱动的方法避免了几何优化策略设计及参数细调;

- 利用transformer 架构解决语义地图元素与相机图片之间的跨模态匹配问题;

- 通过一个统一的BEV 特征空间,利用环视图片来增强感知能力;同时,作者验证了视觉语义定位问题可作为基于BEV 特征大模型的子任务进行解决的可行性;

- 通过大范围数据及验证,作者证明了本方法的优越性。

3 Methods

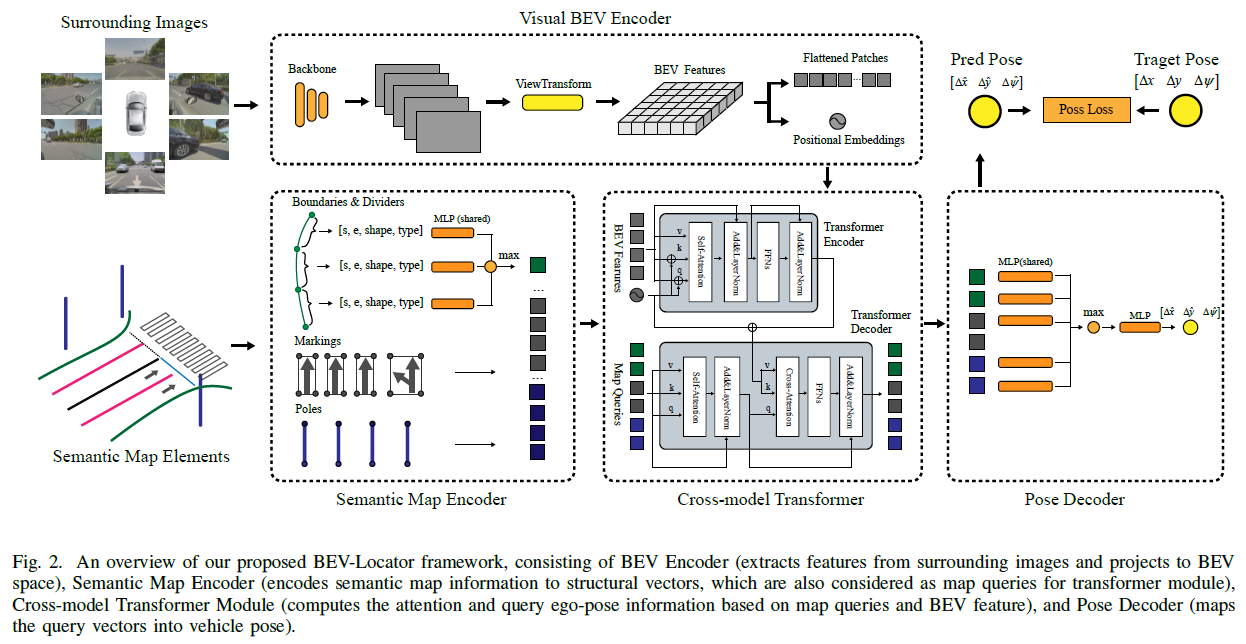

本方法的基本框架如Fig. 2所示,主要包括以下组件:Visual BEV encoder module,Semantic Map encoder module,Cross-model transformer module,以及一个Pose decoder module:

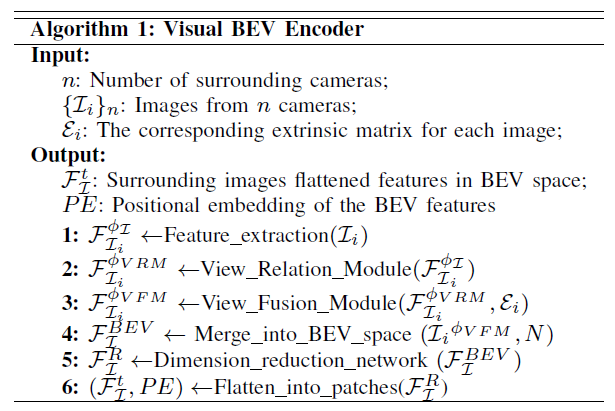

- 环视图片的BEV 特征被Visual BEV Encoder 转换为一个栅格化表示 rasterized representation;

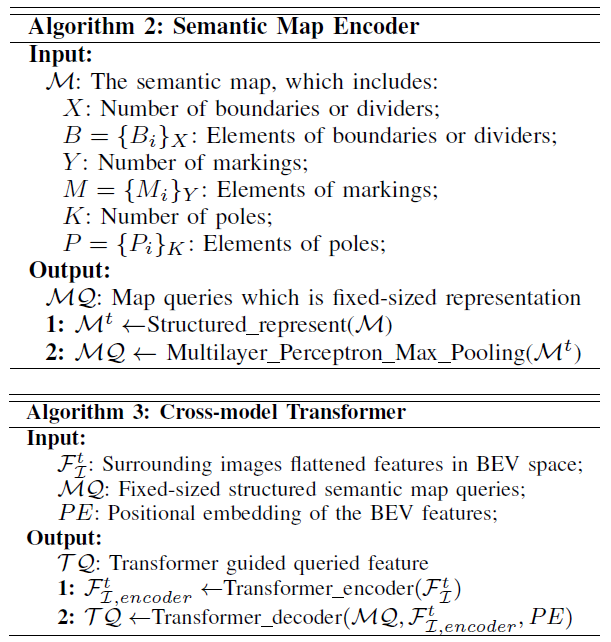

- 语义地图被Semantic Map Encoder 实例化编码为几个压缩向量(也叫做map queries);

- 基于BEV 特征和 map queries,cross-model transformer 模块通过自注意力和交叉注意力计算汽车的queried-out 位姿信息;

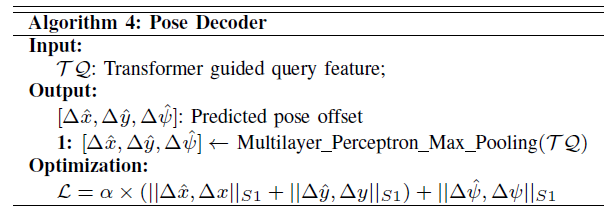

- 基于queried-out 位姿信息,pose decoder 模块根据地图特征和环视图片之间的最优匹配计算出相机的位姿信息。