Gawel, Abel, Carlo Del Don, Roland Siegwart, Juan Nieto, and Cesar Cadena. “X-View: Graph-Based Semantic Multi-View Localization.” IEEE Robotics and Automation Letters (RA-L) 3, no. 3 (2018): 1687–94.

1 Introduction

本文做出的贡献:

- 提出一个新颖的语义拓扑图表示方法;

- 引进了一个基于随机游走的图描述子,可以有效地使用既定的匹配方法进行高效匹配;

- 用于全局定位的语义分割完整pipeline;

- 开源X-View 算法;

- 公开数据集的测试结果。

3 X-View

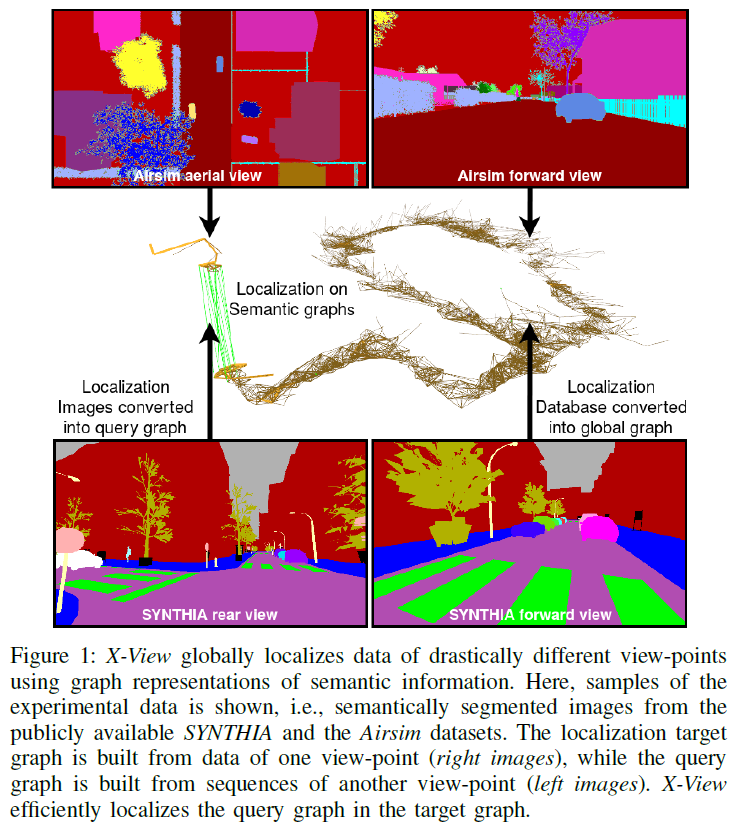

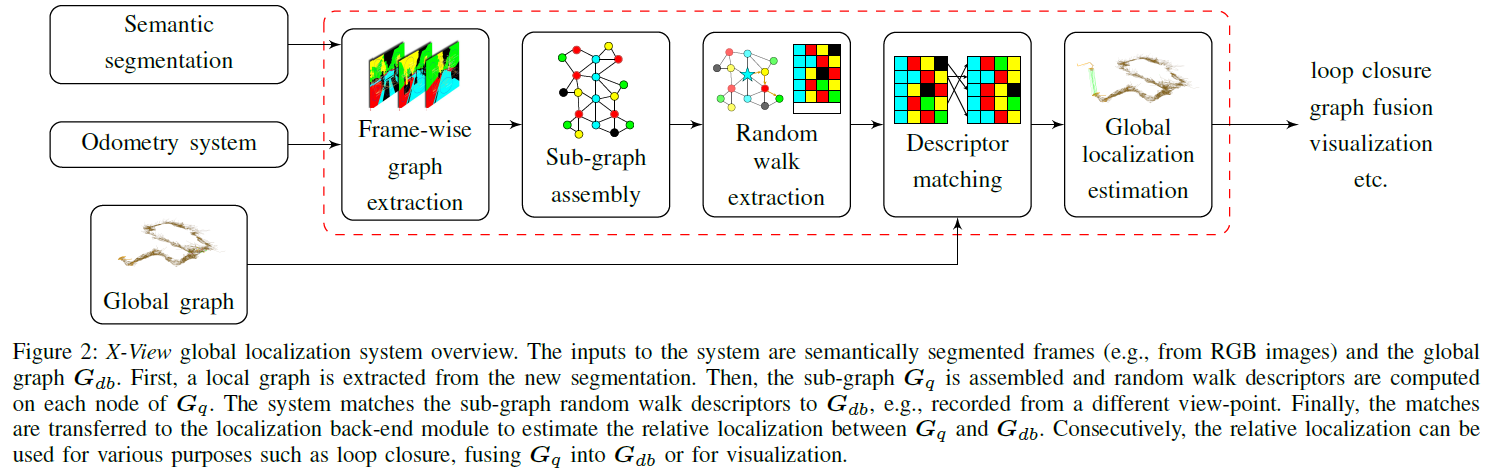

X-View 利用从输入语义数据提取得到的图,并使用图描述子进行图匹配,本文提出的全局定位算法架构如Fig. 2所示,本系统被设计为可以用于任何给定的语义信息作为输入的里程估计系统,为了简化表示,Fig. 2中只列举了语义分割图片作为输入。

3.1 System input

将语义分割或实例分割图片作为系统输入,且假定外部里程系统的估计,以及一个参考语义图 $G_{db}$ 。

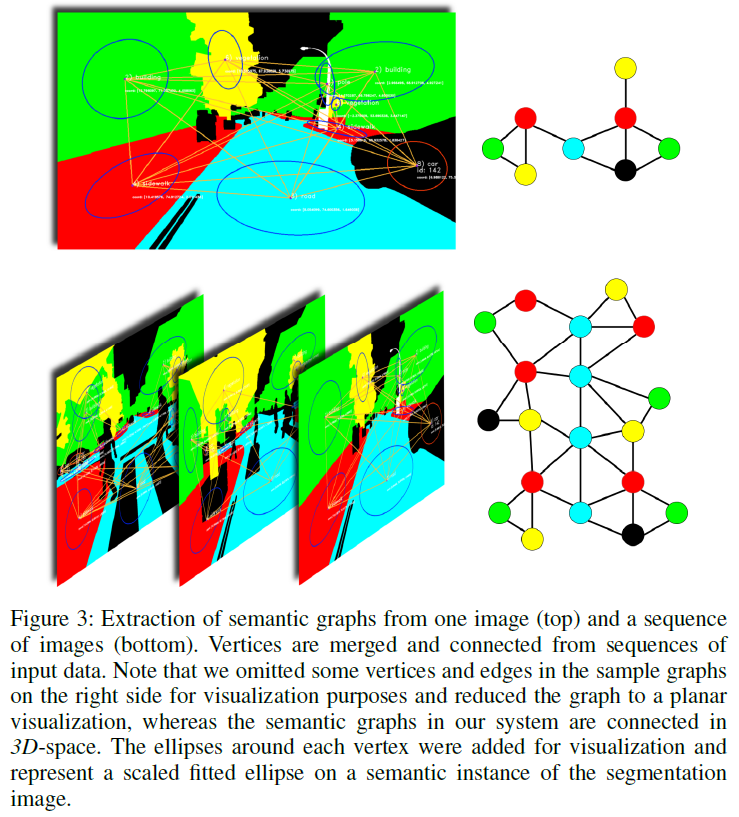

3.2 Graph extraction and assembly

将一系列语义分割图片 $I_q$ 转化为一个质询图 $G_q$ ,从连接区域中提取斑点 blobs,例如每幅图中具有相同语义标签 $l_j$ 的区域。为了应对语义分割的噪声(如标签中的洞、断连的边、边缘错误的标签等),作者使用 dilating 和 eroding 对每个班点的边界进行柔化,且设定最小像素数阈值为4以排除过小及次要物体的影响。斑点的中心位置 $p_j$ 被提取出来,与标签一起存储为顶点 $v_j = \{l_j, p_j\}$ 。

顶点之间的无向边可以是图像空间或3D 空间的,当考虑图像空间中的边时,认为图片在时间序列中根据几幅连续的输入图片流来生成图(利用连续图片获取3D距离信息),在3D 空间中不需要考虑这方面。

利用深度通道数据或者深度估计来组成3D空间结构,使用图片斑点的3D位置来计算欧氏距离,图提取与组合的过程如Fig. 3所示,当对多幅连续图片的图进行组合时,将距离较近且拥有相同语义标签的重复顶点融合为一个顶点,该顶点位置选择为初次观测到的位置。

3.3 Descriptors

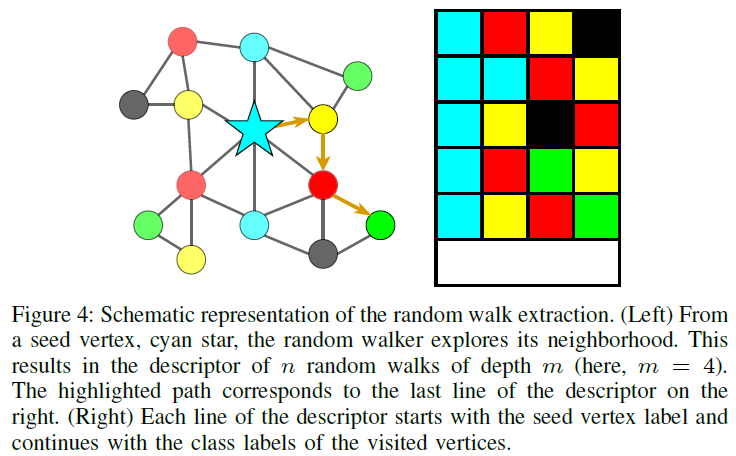

子图匹配是一个 NP-complete 难题,且为了实现机器人的实时定位问题,作者提出了为图中每个节点建立随机游走描述子并进行匹配,这样做的优势是根据给定的静态或者增长的参考图,匹配时间分别是常数或者线性变化的。每个顶点的描述子是一个 $n \times m$ 的矩阵,包含 n 个深度为 m 的随机游走,每个随机游走开始于源顶点 $v_j$ ,并存储访问过顶点的分类标签,随机游走描述子提取过程如Fig. 4所示。

3.4 Descriptor Matching

在质询图 $G_q$ 与 参考图 $G_{db}$ 完成之后,通过计算相应的图描述子之间的similarity score来建立两图顶点之间的联系:

- 相似性是通过对质询图与参考图中顶点的语义描述子的每一行进行匹配计算获取的;

- 两个描述子拥有的相同随机游走数量决定了similarity score(分布在0与1之间);

- 然后选取得分最高的前 k 个匹配顶点对来计算质询图在参考图中的定位信息。

3.5 Localization Back-End

一共有三种类型的约束:

- 来自语义描述子匹配的约束;

- 联系定位图中连续位姿的机器人估计位姿约束;

- 每一个robot-vertex观测的转换信息编码得到的robot-vertex约束。

作者根据以上三个约束参数计算最大后验估计 (MAP)来获取定位信息。

4 Experiments

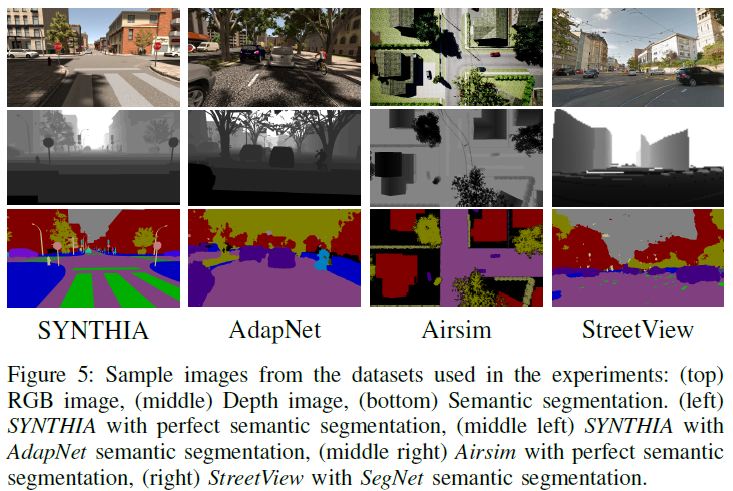

在两个不同的合成户外数据集进行评估,包括前视——后视视角变化、前视——空视视角变化,以及一个真实世界户外数据集,包含前视——后视视角变化。

4.1 Datasets

SYNTHIA 数据集是在城市环境模拟生成的,采集汽车有8个摄像头,四个方向各有两个,相邻图片间的距离在0~1m。作者使用photo-realistic Arisim 生成了空对地观测的数据集,包含空中向地面观测与地面前向观测两种数据,两种数据之间只有在 z 轴存在偏差,其余均相同,相邻图片间的距离总是1m。真实户外场景的数据集是通过Google StreetView 获取的,类似于SYNTHIA 数据集,只使用前视与后视摄像头,相邻图片间的距离接近10m。

4.3 Localization performance

设置两组实验:

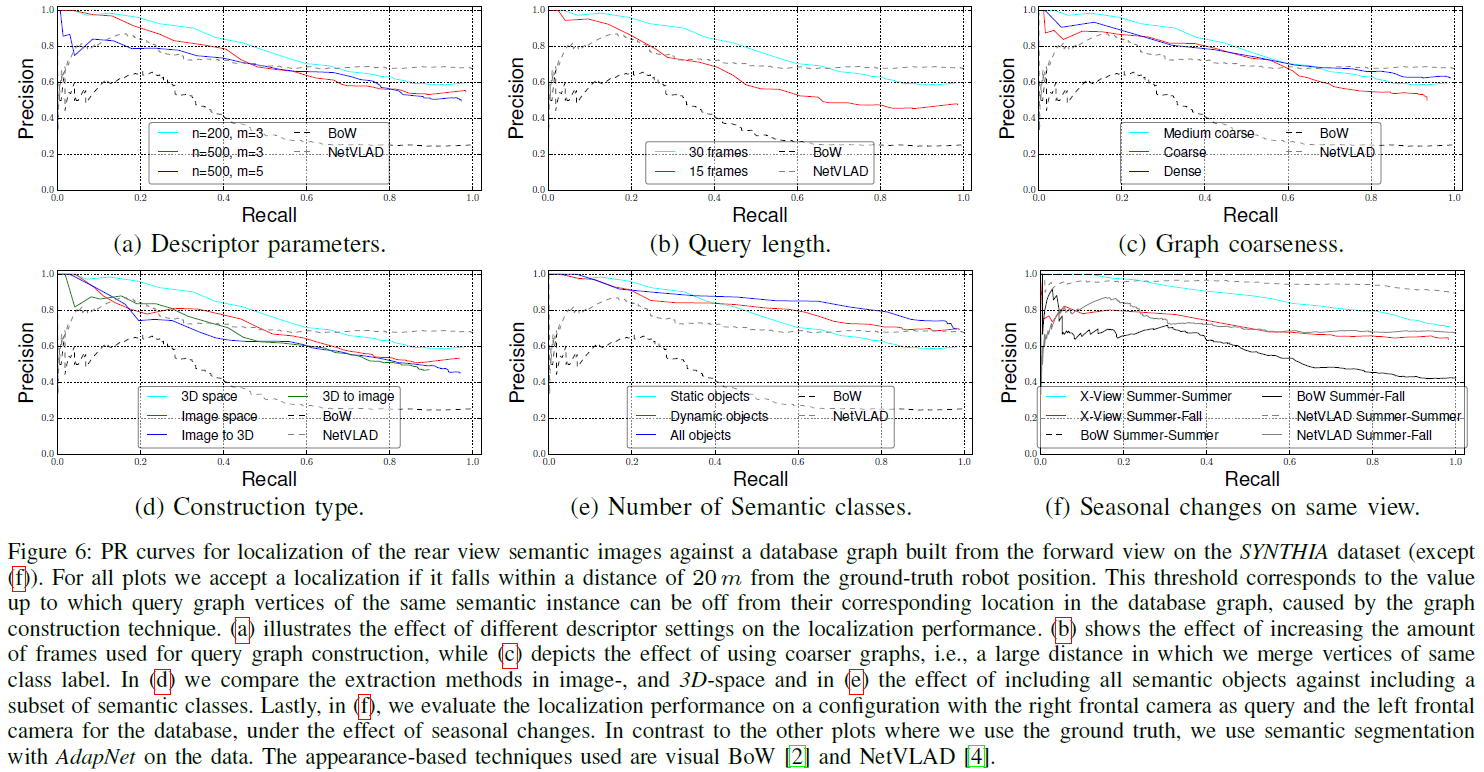

- 在SYNTHIA 数据集上测试不同的参数设置,如随机游走参数、质询图片数量、动态分类物体、图边缘构建技术等;

- 在SYNTHIA、Airsim 以及 StreetView 上进行对比分析实验。

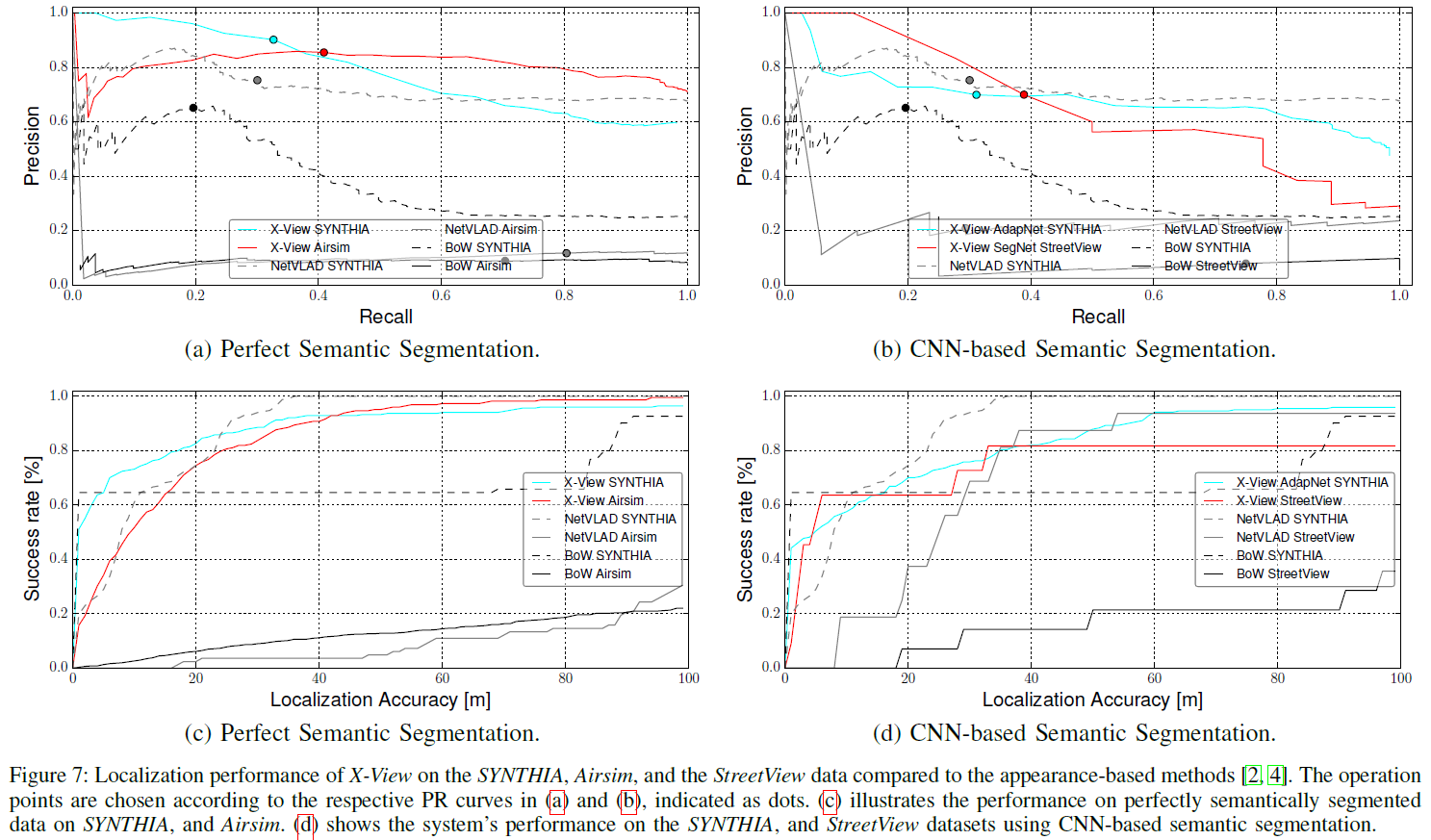

与基于外观匹配的算法进行对比,使用了BoW、NetVLAD 算法。

4.4 Results

Fig. 6是对SYNTHIA 数据集进行的参数对比试验结果。6(a) 中 n 代表随机游走的个数, m 代表随机游走的深度。

PR评估曲线以及不同定位误差下的成功率结果如Fig. 7所示。

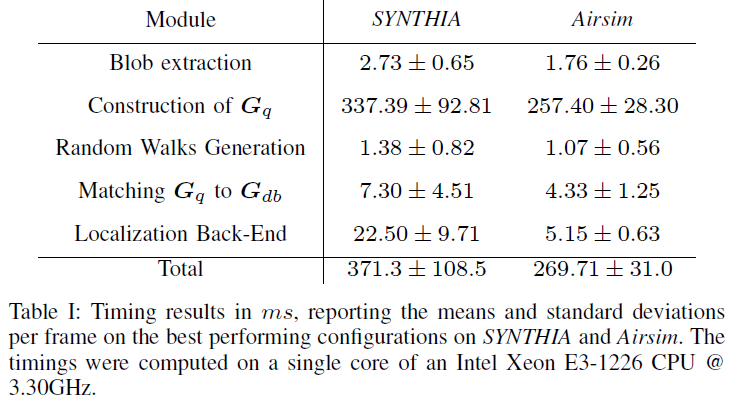

系统组件的时间消耗如Table 1所示。