Lianos, Konstantinos-Nektarios, Johannes L. Schönberger, Marc Pollefeys, and Torsten Sattler. “VSO: Visual Semantic Odometry.” In Computer Vision – ECCV 2018, edited by Vittorio Ferrari, Martial Hebert, Cristian Sminchisescu, and Yair Weiss, 11208:246–63. Lecture Notes in Computer Science. Cham: Springer International Publishing, 2018. https://doi.org/10.1007/978-3-030-01225-0_15.

1 Introduction

作者认为,VO 的核心问题在于数据关联DA。

通常来讲,有两种方法来减少VO 中的漂移:

- 方法一:利用连续图片之间的短期关联来进行偏移矫正;

- 方法二:利用回环检测实现长期关联。

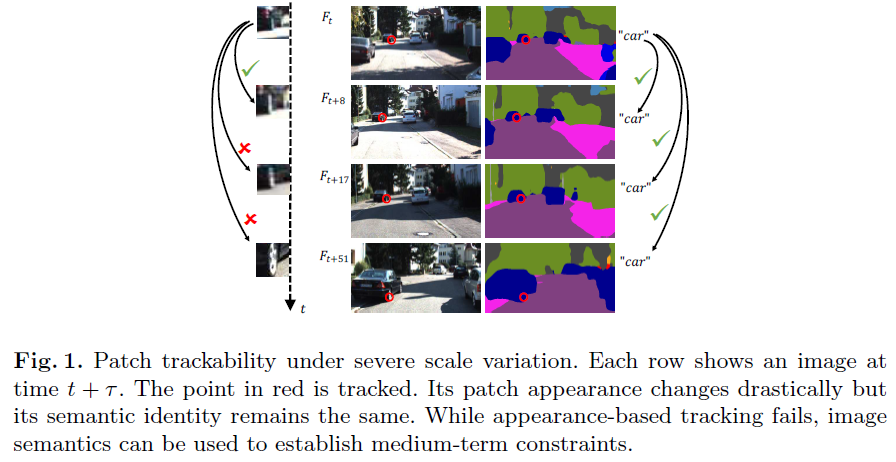

传统的几何特征(点、线、面)在光照、视角变化下鲁棒性较差,不能在长距离上保持持续跟踪,而语义特征作为更高级的特征,语义特征在光照、视角、尺寸发生较大变化时仍然可以保持不变,使得中期关联成为可能,如Fig. 1所示。

本文的贡献如下:

- 构建一个新的损失函数来最小化语义特征的重投影误差,并使用EM 算法进行最小化,且可以适用于任何语义分割算法;

- 作者证明了将语义损失考虑进VO 中可以大幅减小平移漂移,且本算法可以直接集成到现有的VO 算法中,无论是直接法还是间接法;

- 作者进行了实验验证,表明了该算法在特定条件下的效果,并讨论了当前的限制。

3 Visual Semantic Odometry

与文章(Bowman 等, 2017)采用物体的离散DA不同,本文考虑与物体边界的连续距离来定义损失函数。

3.1 Visual Semantic Odometry Framework

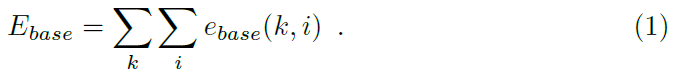

传统里程计的目标函数是:

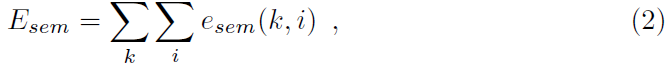

作者定义的语义损失函数是:

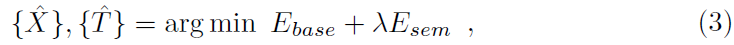

将传统的损失函数和语义损失函数结合起来便形成了本文算法的目标函数:

3.2 Semantic Cost Function

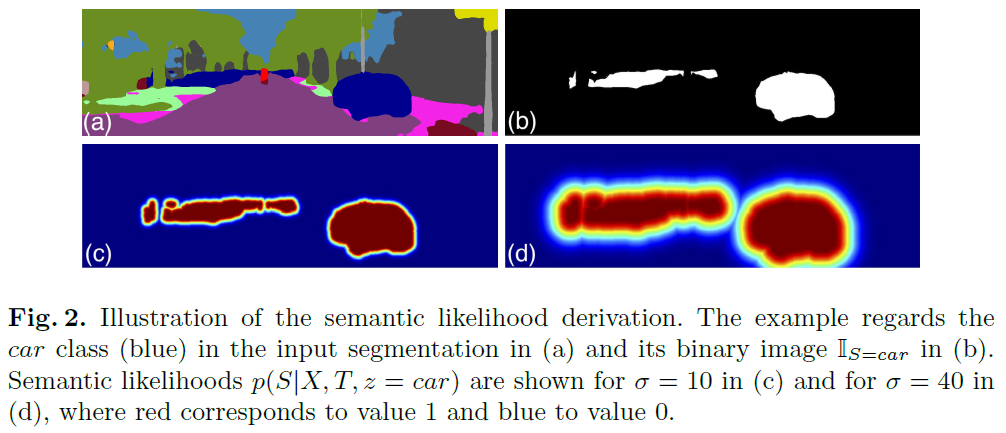

联系语义观测 $S_k$ ,相机位姿 $T_k$ 和3D 点 $P_i$ (包含标签 $Z_i$ 和位置 $X_i$ )来定义观测似然模型:$p(S_k|T_k, X_i, Z_i=c)$ ,该似然函数应该随着 3D 点 $P_i$ 在图片中的投影位置 $\pi(T_k, X_i)$ 与标注为类别 c 的区域的最近距离成反比;基于此,作者利用了distance transform,如Fig. 2所示,作者首先由语义分割图片(a)为每一个分类 c 生成相应的二分值灰度图片(b),然后基于该灰度图片定义一个distance transform:

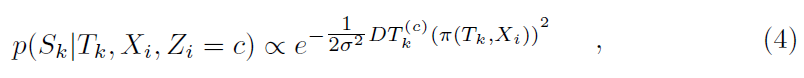

利用 $DT^{(c)}_k(p)$ 定义观测似然函数:

其中,$\pi$ 表示投影函数;$\sigma$ 表示语义图片分类的不确定性。为了简明起见,作者省略了归一化因子。根据上式,可通过调整相机位姿与点的位置,使得投影点移动到正确标签的区域内,以此最大化该似然函数。

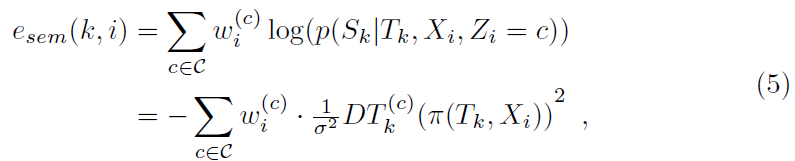

根据式(4)作者定义了语义损失项:

其中,$w_i^{(c)}$ 表示点 $P_i$ 属于种类 c 的概率。从上式可以看出,$e_{sem}(k,i)$ 表示2D 距离的加权平均,每个投影点 $\pi(T_k, X_i)$ 到最近属于种类 c 的距离 $DT^{(c)}_k(\pi(T_k, X_i))$ 被相应的类别概率 $w_i^{(c)}$ 加权。

值得注意的是,对于点 $P_i$ 的标签概率向量 $w_i$ 是通过所有对到该点的观测计算得到的:

其中,$\mathcal{T}_i$ 表示观测到点 $P_i$ 的相机位姿集合;参数 $\alpha$ 为归一化参数。利用该准则可以通过累积语义观测来实现对标签概率向量 $w_i$ 的增量式细调。

3.3 Optimization

式(5)、(6)表明优化参数涉及3D 点位置坐标,相机位姿以及种类关联参数,作者使用EM 算法进行求解,步骤如下:

- E step:基于式(6)计算每个点的权重向量 $w_i$ ,此步骤点坐标和相机位姿保持固定;

- M step:优化点坐标和相机位姿,此步骤权重参数保持固定。

该优化框架中,将点 $P_i$ 的标签 $Z_i$ 视为隐变量。

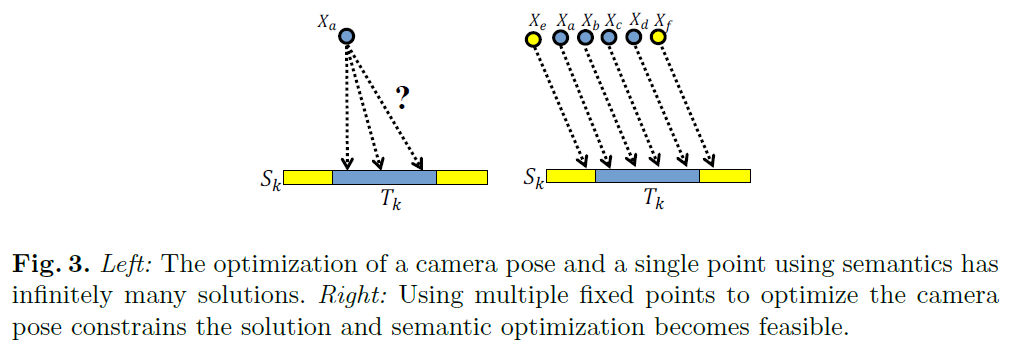

作者提到,使用本文提出的语义约束,可以实现不变观测,但是缺乏结构信息;仅使用语义项对地图点和相机位姿进行优化会导致欠约束,因为等式(4)表示的似然函数在物体边界内部服从均匀分布,为解决该问题,对于 $E_{sem}$ 的优化操作如下:

- 如式(3)所示,与传统的VO 进行联合优化;

- 利用多重点和语义约束来优化相机位姿;

- 仅提供语义约束的点得到固定,然后只优化与它们相关的相机位姿来减小漂移,该方法不仅可以限制优化参数的数量,而且会在点之间引入结构相关,从而约束位姿求解(如Fig. 3所示);

- 频繁使用语义优化可以减少一个点错误关联的概率,因为基于distance transform 梯度的优化可以保证该点足够靠近正确标签的区域,并不断拉向该区域。

3.4 Obtaining Semantic Constraints & System Integration

类似于传统VO 使用的关键帧active window (AW),作者也定义了一个关键帧active semantic window (ASW),一个关键帧从AW 中剔除后会被添加进ASW,本算法在尽可能覆盖更多的轨迹的同时,也会限制ASW 中关键帧的数量。且,ASW 中关键帧的位姿不再进行优化,因为这些关键帧通常与目前的帧缺少光度/几何约束。